LLM

LLM ollamaのversion0.30が正式リリースされたのでRadeon780Mで利用するための設定をする

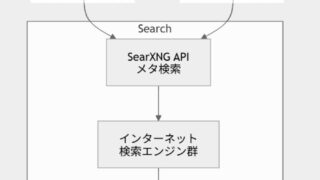

目的ollama verson 0.30以降から、lamma.cppと同等の推論エンジンになり高速化されたので、その検証github copilotが6月1日からの規約変更で使い物にならなくなった。その代替としてローカルLLMを利用するDe...

LLM

LLM  LLM

LLM  LLM

LLM  Nextcloud

Nextcloud  MySQL

MySQL  Nvidia

Nvidia  cloudfront

cloudfront  AWS

AWS  Nvidia

Nvidia  ubuntu

ubuntu